“Dijital Teknolojileri Kullanarak Nefret Söylemi ve Ayrımcılıkla Mücadele” projesi kapsamında düzenlenen panel serisinin dördüncüsü “İnsan Hakları Bağlamında Algoritmaların Dizaynı” başlıklı panel, 10 Kasım 2023'te Hrant Dink Vakfı Havak Salonu’nda yapıldı. Panel, vakfın YouTube hesabından İngilizce ve Türkçe olarak canlı yayınlandı.

İki oturumdan oluşan panelin ‘Güvenilir Algoritmalar Tasarlamak’ başlıklı ilk oturumunda Melis Öneren Özbek’in moderasyonunda, Tanu Mitra ve Gözde Gül Şahin güvenilir algoritmaların nasıl oluşturulabileceği konusuna odaklanırken, Sarah Eagan Twitter/X platformundaki değişikliklerin algoritmalara etkilerine değindi.

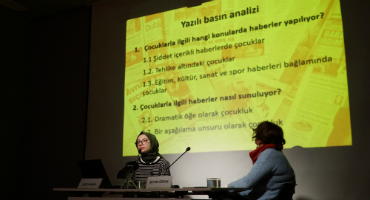

I. Oturum: Güvenilir Algoritmalar Tasarlamak

Konuşmacılar: Sarah Eagan, Gözde Gül Şahin, Tanu Mitra

Moderatör: Melis Öneren Özbek

Center for Countering Digital Hate’den (CCDH) Sarah Eagan, konuşmasına sosyal medya şirketlerinin nefret söyleminin ve dezenformasyonun yayılmasındaki rolüne değinerek başladı. CCDH’in Instagram ve TikTok’un öneri algoritmalarıyla ilgili yaptığı araştırmalara değinen Eagan, platformların savunmasız olarak değerlendirdiği kullanıcılara daha fazla zararlı içerik önerme eğiliminde olduğunu bulduklarını belirtti. Musk’ın satın almasıyla Twitter’ın akademik erişimleri kısıtlaması, doğrulanmış hesapların bu niteliğini kaybetmesi, daha önce yasaklanan kullanıcıların geri dönmesi gibi nedenlerle ayrımcı ve saldırgan ifadelerin platformda daha fazla yer bulduğuna dikkat çekti.

Koç Üniversitesi’nden Gözde Gül Şahin, dil modellerin düzgün bir şekilde eğitilmesi için geniş miktarda eğitim veri setine ihtiyaç duyulduğuna değindi. Farklı modellerin nasıl eğitildiğini ve sıralandığını zaman sırasına göre açıkladı, örnekler üzerinden modellerin en iyi versiyonunun oluşturulabileceğini belirtti. Söz konusu modellerin tarafsız bilgi üretmek amacıyla oluşturulmadığını, yapay zekâ araçlarının insanların kötüye kullanımını destekleyecek şekilde önyargılı ve toksik bilgi üretmeye koşullandırılabileceğine dikkat çekti. Bu sorunları çözmek için herhangi bir stratejinin bulunmadığını belirten Şahin, yapay zekâ araçlarının yanlış veya zararlı bilgi üretip üretmediğini tespit edebilmeleri için kullanıcıların gerekli bilgiye sahip olmalarının önemini vurgulayarak konuşmasını tamamladı.

Washington Üniversitesi'nden Tanu Mitra, Algoritmik Yönetişim konusunda Sosyal Bilişim araştırma ekibinin çalışmalarını anlattı. YouTube ve Amazon odaklı iki araştırmada, platformların arama ve öneri algoritmalarını, yanlış ve eksik bilginin yayılmasındaki rollerini tespit etmek için denetlediklerinden bahsetti. Araştırma sonucunda pro/çürütme/tarafsız komplo temalı videolar içeren bir izleme geçmişine sahip hesaplar için YouTube'un daha fazla komplo videosu önerdiğini tespit ettiklerini, bunun da kullanıcıları yankı odalarına yerleştirmenin bir yolu olduğunu söyledi. Geleneksel öneri algoritmalarının tüm konular için sorgulanmadan uygulanmaması gerektiğini tavsiye eden Mitra, sosyal medya şirketlerinin denetlenmesi konusunda denetimlerin önemine vurgu yaptı. Şirketlerin üçüncü bir tarafa hesap verdiği dış denetimler veya şirketlerin algoritmalarını dış işbirlikçilerle birlikte paylaşmaya ve düzenlemeye zorlandığı kooperatif denetimler gibi birçok denetim türü bulunduğundan bahsetti. Sosyal medya şirketlerinin incelenmesi ve kullanıcılarına zararlı olabilecek algoritmik tasarımları konusunda sorumluluklarını yerine getirmeleri için uygulanabilecek denetimlerin gerçek hayatta değişiklik yaratabileceğini belirterek konuşmasını sonlandırdı.

Panelin ‘İnsan Hakları Bağlamında Verilerle Algoritmaların İlişkisi’ isimli ikinci oturumunda Selin Çetin’in moderasyonunda, Shmyla Khan, Lisa Ginsborg ve Gökhan Ahi, teknoloji ve insan hakları bağlamında algoritmaların dizaynında verilerin nasıl işlendiğini hukuki çerçeveyle ilişkili olarak değerlendirdiler.

II. Oturum: İnsan Hakları Bağlamında Verilerle Algoritmaların İlişkisi

Konuşmacılar: Gökhan Ahi, Shmyla Khan, Lisa Ginsborg

Moderatör: Selin Çetin

İkinci oturumun ilk konuşmacısı Gökhan Ahi, artan popülizmin sonuçlarını sosyal medya şirketlerinin uygulamalarıyla ilişkili olarak değerlendirdi. Sosyal medya platformlarında kullanılan algoritmaların yankı odaları ve yanlış ve eksik bilgiyle popülizmi beslediğine değindi. Algoritmalar aracılığıyla yayılan yanlış ve eksik bilgilerin, ayrımcı söylemin doğru bilgilere kıyasla çok daha hızlı yayıldığını vurguladı. Bunun önüne geçmek için farklı ülkelerde yapılan düzenlemeler olsa da yapılan düzenlemelerin yeterli olmadığını, algoritmaların dizaynında çoğulculuğun ve uluslararası işbirliklerinin ön plana çıkarılması gerektiğini belirtti.

Oturumun ikinci konuşmacısı Shmyla Khan, yapay zekâ algoritmalarının Küresel Güney’de düşük ücretle satın alınan emekle üretildiğine, ancak, bu teknolojilerin Küresel Kuzey’de geliştirildiğine dikkat çekerek konuşmasına başladı. Yapay zekâ teknolojilerinin bu yolla üretilmesinin marjinalleştirilmiş toplulukları etkileyen algoritmik ayrımcılığa yol açtığını, yapılan düzenlemelerin Küresel Kuzey’i göz önünde bulundurarak hazırlandığı için dünyanın geri kalanında yetersiz olduğunu belirtti. Konuşmasına, yapay zekânın veri ve insan deneyiminden oluştuğunu belirterek devam eden Khan, algoritmaların nötr olmadığını, aslında yapay zekânın cinsiyet veya ırka dayalı ayrımcılığı pekiştirdiği konusunda geniş bir literatür bulunduğunu tartıştı. AB Yapay Zekâ Yasası gibi yapay zekâyı kapsayan düzenlemelerin olmasına rağmen, içeriğinin sınırlı olduğunu ve yasada belirtilen risklerin etnik ve cinsiyet temelli ayrımcılığı kapsamadığını ifade etti. Konuşmasını, düzenlemelerin insan hakları etrafında odaklanması gerektiğini ve politika oluşturmanın kapsayıcı ve işbirlikçi olması gerektiğini belirterek tamamladı.

European Digital Media Observatory’den (EDMO) Lisa, konuşmasına EDMO'nun eksik ve yanlış bilgiye karşı toplumsal direnci arttırmaya yönelik çalışmalarını, gazetecilik, medya okuryazarlığı, doğruluk kontrolü ve bu kavram etrafında yapılan araştırmalarını ele alarak başladı. Sosyal medya şirketlerinin algoritmaları konusunda gizemli olmamaları gerektiğini, algoritmaların ne için tasarlandığının şeffaflıkla paylaşılması gerektiğini belirtti. Ginsborg, Digital Services Act (DSA) kapsamındaki şeffaflık raporlarının şirketlerin içerik düzenleme politikalarıyla ilgili olduğunu ve bu raporlardaki şeffaflığın çok sınırlı olduğunu, şirketlerin karar alma süreçleriyle ilgili bilgileri gizlemeye eğilimli olduklarını savundu. Benzer şekilde, veri erişimi konusunda da son yasama çerçevesinde DSA'ya göre kamusal verilerin sosyal medya şirketleri tarafından erişilebilir hâle getirilmesi gerektiğini belirtti, ancak, şirketlerin bu erişimi aktif bir şekilde engellediklerini ifade etti.

Bu proje Avrupa Birliği tarafından finanse edilmektedir.